22/04/2026 07:10น.

EP.70 การปรับปรุงประสิทธิภาพ WebSocket Server ด้วยการใช้ Load Balancer

#WebSocket Load Balancing

#WebSocket Server performance

#Load Balancer WebSocket

#WebSocket scalability

#High availability WebSocket

ใน EP.70 นี้เราจะพูดถึงการ ปรับปรุงประสิทธิภาพ WebSocket Server ด้วยการใช้ Load Balancer เพื่อเพิ่มประสิทธิภาพในการกระจายโหลดของการเชื่อมต่อหลายๆ รายการระหว่าง Client และ Server โดยการใช้ Load Balancer สามารถช่วยให้ WebSocket Server ของเรารองรับการเชื่อมต่อจำนวนมากได้โดยไม่มีการสะดุดหรือความช้าในการส่งข้อมูล

การใช้ Load Balancer จะช่วยแบ่งการทำงานของเซิร์ฟเวอร์ให้กระจายไปยังหลายๆ เซิร์ฟเวอร์เพื่อเพิ่มประสิทธิภาพในการจัดการการเชื่อมต่อ และช่วยให้ระบบมีความยืดหยุ่นในการขยายขนาด (scalability) รวมทั้งช่วยให้ระบบมีความทนทาน (high availability) ในกรณีที่เซิร์ฟเวอร์หนึ่งล้มเหลว

ทำไมต้องใช้ Load Balancer ใน WebSocket Server?

การใช้ Load Balancer ใน WebSocket Server จะช่วยเพิ่มประสิทธิภาพและความสามารถในการจัดการการเชื่อมต่อที่มีจำนวนมาก โดยมีข้อดีดังนี้:

- กระจายโหลดอย่างมีประสิทธิภาพ:

ช่วยกระจายการเชื่อมต่อจากผู้ใช้งานไปยังหลายๆ เซิร์ฟเวอร์ ช่วยลดภาระงานของเซิร์ฟเวอร์หลัก - เพิ่มความทนทาน (High Availability):

หากเซิร์ฟเวอร์หนึ่งล้มเหลว Load Balancer สามารถเปลี่ยนเส้นทางการเชื่อมต่อไปยังเซิร์ฟเวอร์ที่พร้อมใช้งาน - รองรับการขยายระบบ (Scalability):

การใช้ Load Balancer ทำให้สามารถเพิ่มเซิร์ฟเวอร์ใหม่ได้ง่ายๆ เมื่อระบบมีการขยายตัวหรือจำนวนผู้ใช้เพิ่มขึ้น - ป้องกันการจราจร (Traffic Management):

ช่วยจัดการปริมาณข้อมูลที่ส่งไปมาระหว่าง Client และ Server โดยการแบ่งการโหลดไปยังเซิร์ฟเวอร์หลายๆ ตัว

โครงสร้างของ Load Balancer ใน WebSocket Server

WebSocket ที่รองรับการเชื่อมต่อแบบเรียลไทม์และต่อเนื่องจะมีปัญหาถ้ารับการเชื่อมต่อจากผู้ใช้จำนวนมากในเวลาเดียวกัน การใช้ Load Balancer สามารถช่วยแก้ไขปัญหานี้ได้ โดยทำหน้าที่กระจายการเชื่อมต่อไปยังเซิร์ฟเวอร์ที่มีอยู่หลายๆ ตัว

ขั้นตอนการตั้งค่า Load Balancer สำหรับ WebSocket Server

- เลือก Load Balancer ที่เหมาะสม:

- มี Load Balancer ที่รองรับการเชื่อมต่อ WebSocket เช่น NGINX, HAProxy, หรือ AWS Elastic Load Balancing (ALB)

- ในการเลือก Load Balancer ควรเลือกที่รองรับ WebSocket และสามารถทำ sticky sessions หรือ session persistence ได้

ตั้งค่า WebSocket Server:

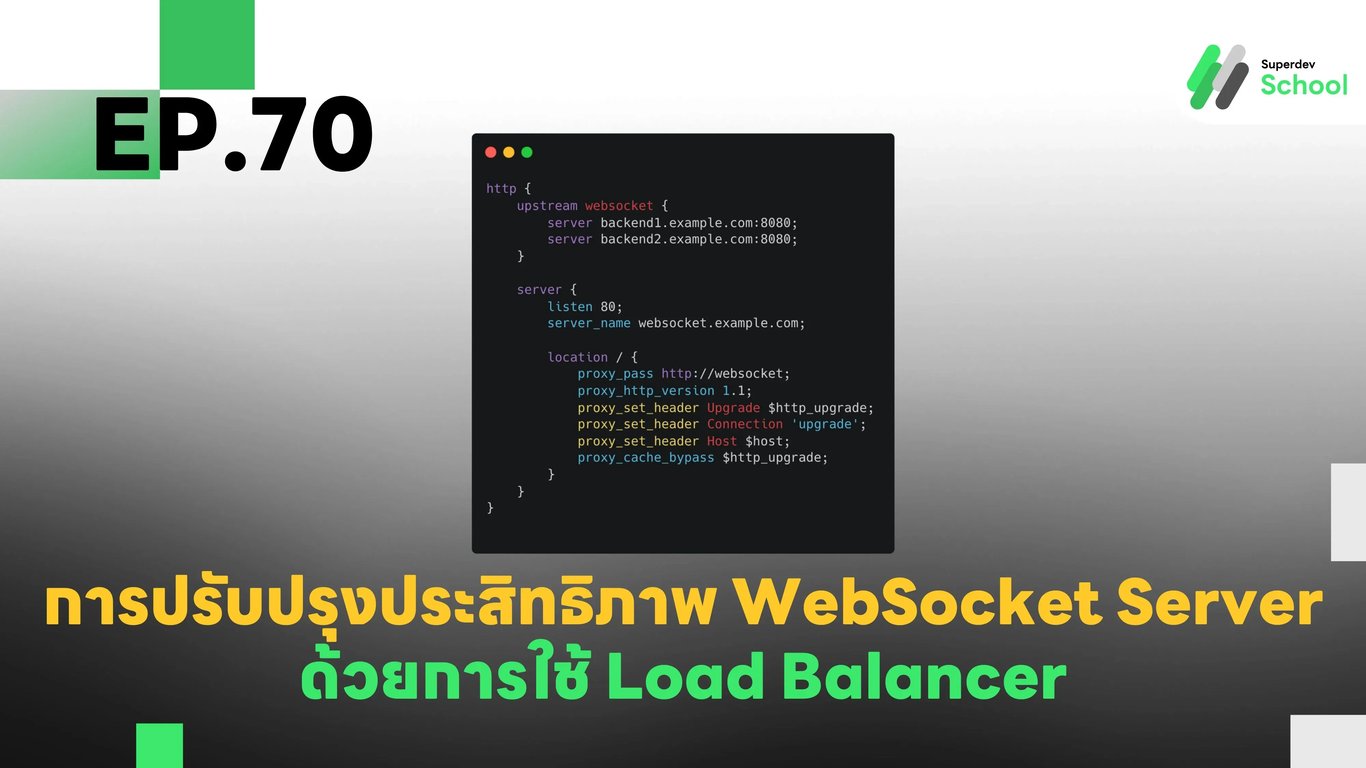

เราจะต้องตั้งค่า WebSocket Server ให้สามารถทำงานร่วมกับ Load Balancer และรองรับการเชื่อมต่อจากหลายๆ เซิร์ฟเวอร์ตัวอย่างโค้ดการตั้งค่า NGINX เป็น Load Balancer:

http { upstream websocket { server backend1.example.com:8080; server backend2.example.com:8080; } server { listen 80; server_name websocket.example.com; location / { proxy_pass http://websocket; proxy_http_version 1.1; proxy_set_header Upgrade $http_upgrade; proxy_set_header Connection 'upgrade'; proxy_set_header Host $host; proxy_cache_bypass $http_upgrade; } } }การตั้งค่า WebSocket Server:

ในส่วนของ WebSocket Server เราจะต้องใช้เซิร์ฟเวอร์ที่สามารถรับคำขอ WebSocket จาก Load Balancer โดยการตั้งค่าการรับข้อมูลและส่งข้อมูลตามลำดับตัวอย่างโค้ดการตั้งค่า WebSocket Server ด้วย Go:

package main import ( "log" "net/http" "github.com/gorilla/websocket" ) var upgrader = websocket.Upgrader{ CheckOrigin: func(r *http.Request) bool { return true }, } func handler(w http.ResponseWriter, r *http.Request) { conn, err := upgrader.Upgrade(w, r, nil) if err != nil { log.Println(err) return } defer conn.Close() for { messageType, p, err := conn.ReadMessage() if err != nil { log.Println(err) break } err = conn.WriteMessage(messageType, p) if err != nil { log.Println(err) break } } } func main() { http.HandleFunc("/", handler) log.Fatal(http.ListenAndServe(":8080", nil)) }- ตรวจสอบการทำงาน:

หลังจากตั้งค่า WebSocket Server และ Load Balancer เสร็จสิ้นแล้ว ขั้นตอนต่อไปคือการทดสอบว่าระบบทำงานได้ดีในสถานการณ์ที่มีการเชื่อมต่อจำนวนมาก:- ทดสอบการเชื่อมต่อจำนวนมาก

- ตรวจสอบว่า Load Balancer ทำหน้าที่กระจายการโหลดได้ดีหรือไม่

- ทดสอบการทำงานของ WebSocket Server เมื่อเซิร์ฟเวอร์หนึ่งล้มเหลว

ท้าให้ลอง!

ลอง ปรับปรุง WebSocket Server ของคุณโดยการใช้ Load Balancer และทดสอบประสิทธิภาพกับผู้ใช้งานจำนวนมากเพื่อให้มั่นใจว่าระบบสามารถรองรับการขยายตัวในอนาคตได้อย่างมีประสิทธิภาพ!